近年來,人工智能生成內(nèi)容(AIGC)領(lǐng)域飛速發(fā)展,其中Stable Diffusion作為領(lǐng)先的圖像生成模型,因其強(qiáng)大的創(chuàng)意能力和高質(zhì)量的圖像輸出而備受關(guān)注。傳統(tǒng)上Stable Diffusion依賴于云端服務(wù)器或高性能計(jì)算機(jī),這限制了其在移動(dòng)設(shè)備上的應(yīng)用。如今,全球首個(gè)運(yùn)行在Android手機(jī)上的Stable Diffusion終端側(cè)演示應(yīng)用軟件成功問世,標(biāo)志著移動(dòng)端AI生成內(nèi)容的重大突破。

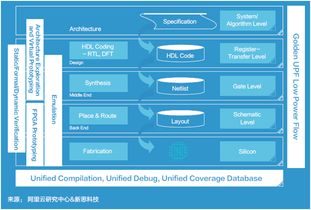

該應(yīng)用軟件開發(fā)基于先進(jìn)的模型優(yōu)化技術(shù),將Stable Diffusion模型進(jìn)行壓縮和量化,使其能夠在Android手機(jī)的ARM架構(gòu)處理器上高效運(yùn)行。開發(fā)者采用了輕量化的神經(jīng)網(wǎng)絡(luò)架構(gòu)和內(nèi)存管理策略,確保即使在資源受限的移動(dòng)設(shè)備上,也能實(shí)現(xiàn)快速的圖像生成,而無需依賴網(wǎng)絡(luò)連接。這一創(chuàng)新不僅提升了用戶體驗(yàn),還增強(qiáng)了數(shù)據(jù)隱私保護(hù),因?yàn)樗杏?jì)算均在本地完成。

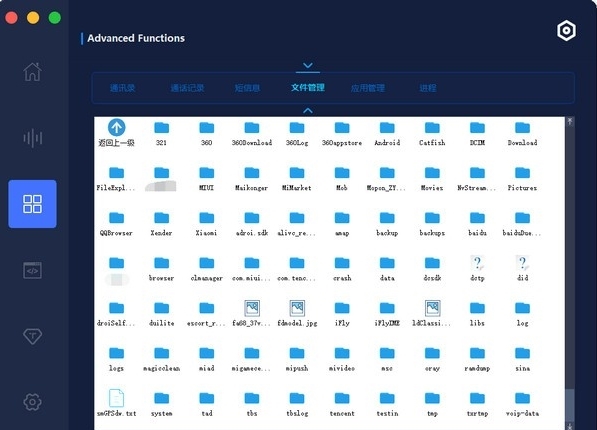

在功能方面,這款應(yīng)用軟件支持用戶通過文本提示詞實(shí)時(shí)生成高質(zhì)量圖像,例如輸入“日落的森林風(fēng)景”,即可在數(shù)秒內(nèi)獲得一張逼真的AI繪圖。應(yīng)用還集成了實(shí)時(shí)預(yù)覽和編輯功能,允許用戶調(diào)整模型參數(shù),如風(fēng)格強(qiáng)度和分辨率,以適應(yīng)不同場景需求。開發(fā)團(tuán)隊(duì)通過多線程處理和GPU加速技術(shù),進(jìn)一步優(yōu)化了性能,使其能在主流Android設(shè)備上流暢運(yùn)行,即使是中低端手機(jī)也能體驗(yàn)這一前沿技術(shù)。

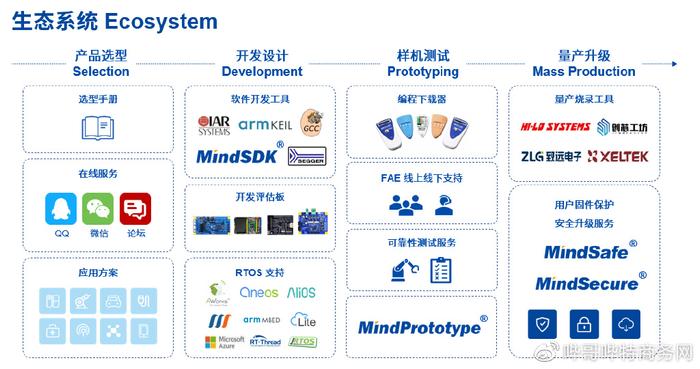

這一突破的意義深遠(yuǎn)。它推動(dòng)了AI民主化進(jìn)程,讓更多用戶無需昂貴硬件即可享受AIGC帶來的便利。它為移動(dòng)應(yīng)用開發(fā)者開辟了新方向,例如在社交、教育和娛樂領(lǐng)域集成圖像生成功能。未來,隨著模型優(yōu)化技術(shù)的進(jìn)步和硬件性能的提升,我們有望看到更多類似應(yīng)用涌現(xiàn),進(jìn)一步豐富移動(dòng)端AI生態(tài)。

全球首個(gè)Android手機(jī)上的Stable Diffusion終端側(cè)演示應(yīng)用軟件的開發(fā),不僅是技術(shù)上的里程碑,更是創(chuàng)新應(yīng)用的催化劑。它展示了移動(dòng)設(shè)備在處理復(fù)雜AI任務(wù)方面的潛力,激勵(lì)著全球開發(fā)者繼續(xù)探索AI與移動(dòng)技術(shù)的融合。我們期待這一成果能激發(fā)更多創(chuàng)新,推動(dòng)AIGC走進(jìn)日常生活。